Dedicated Server oder Cloud 2026: So entscheidest du pro Workload

TL;DR

- Dedicated Server gewinnen, wenn Workloads stabil 24/7 laufen, latenz-sensitiv sind oder viel Datenverkehr nach außen erzeugen (weil Outbound Bandbreite/Egress in der Cloud explizit bepreist wird).

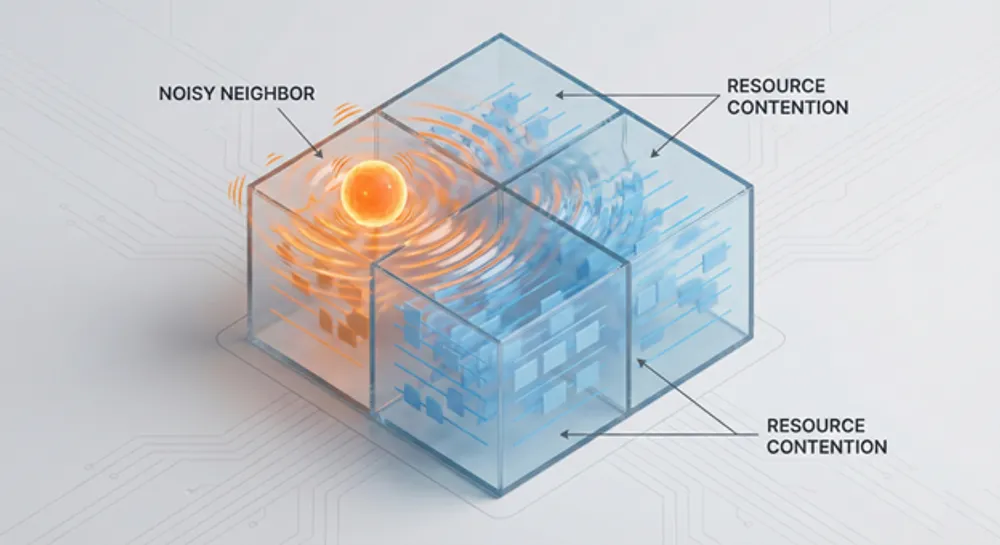

- Performance-Vorhersagbarkeit ist ein legitimer Treiber: Multi-Tenant-Umgebungen können unter „Noisy Neighbor“-Effekten leiden (ein bekanntes Shared-Resource-Risiko).

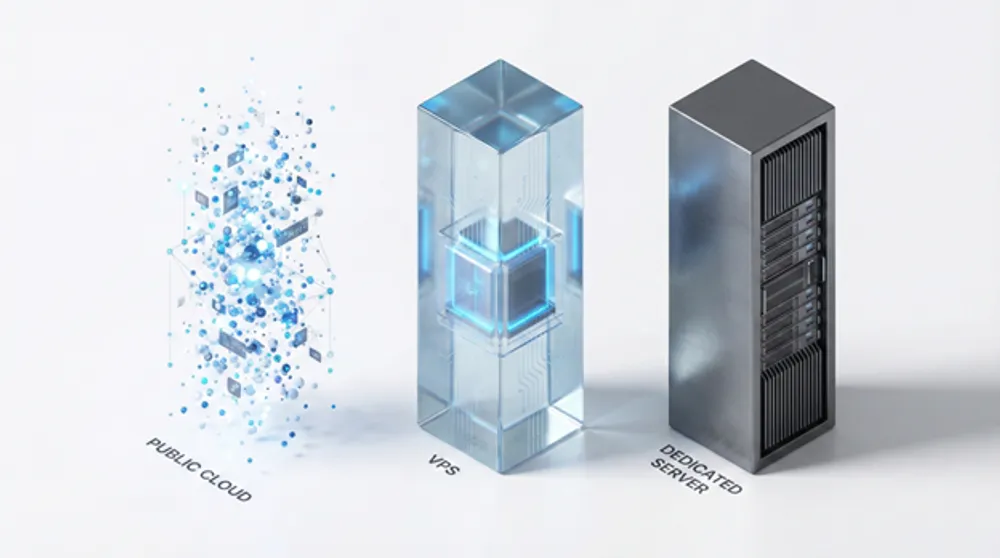

- VPS ist der Mittelweg: oft die richtige Wahl, wenn du „einen Server willst, den du selbst kontrollierst“, ohne Hardware zu besitzen—aber Multi-Tenant-Variabilität kann trotzdem auftreten.

- Verdikt: Nutze Cloud für Bursts, Geschwindigkeit, Managed Services und Unsicherheit. Nutze VPS für einfache, moderate, planbare Services, bei denen Multi-Tenancy akzeptabel ist. Nutze Dedicated (Bare Metal) für Base Load, konsistente Performance und stärkere operative Kontrolle—sofern du es sauber betreiben kannst.

Wann ergibt es heute wirklich Sinn, einen eigenen Dedicated Server zu betreiben?

Jahrelang galt „ab in die Cloud“ als Default—fast wie eine moralische Entscheidung. Doch 2026 ist die ehrliche Infrastrukturfrage selten „Cloud vs. On-Prem“.

Sie lautet: Wo gehört diese konkrete Workload hin—gemessen an Nutzungsmuster, Risikoprofil und Economics?

Diese Verschiebung wird oft als Cloud Repatriation beschrieben: bestimmte Workloads aus der Public Cloud zurück auf Dedicated Infrastruktur oder hybride Deployments zu holen. Das ist kein Massen-Exodus. Es ist das, was Reife bedeutet, wenn Teams aufhören, Narrativen hinterherzulaufen, und Workloads dort platzieren, wo sie operativ und finanziell Sinn ergeben.

Die Frage ist also nicht „Ist Cloud jetzt schlecht?“

Sondern: Wann zahlst du Cloud-Preise für Vorteile, die du gar nicht nutzt?

Denn Cloud ist nicht „ein Computer“. Cloud ist ein Bundle:

- Elastizität on demand

- Managed Services und APIs (Datenbanken, Queues, Object Storage, IAM)

- schnelle Provisionierung und Automation-Primitives

- globale Reichweite

- Hardware-Abstraktion (jemand anders kümmert sich um defekte Komponenten)

Wenn du dieses Bundle wirklich brauchst, ist Cloud oft die rationale Wahl.

Wenn deine Workload aber planbar ist, immer läuft und sensibel auf Latenz oder Datenverkehr reagiert, können Cloud-Stärken zu teurem Ballast werden—zumal Provider Outbound Data Transfer/Bandbreite (Egress) explizit bepreisen und verteilte Architekturen zusätzlichen Cross-Boundary-Traffic erzeugen können.

Dieser Guide gibt dir ein Decision Framework, das praktisch ist—nicht ideologisch.

Der eigentliche Trade-off: Elasticity Tax vs. Responsibility Tax

Ein Dedicated Server macht Infrastruktur nicht „magisch einfacher“. Er verändert vor allem welchen Schmerz du bezahlst.

In der Cloud zahlst du eine „Elasticity Tax“

Du bezahlst für Optionalität: schnell hoch-/runterskalieren, einfacher failovern, Umgebungen in Minuten starten und Managed Services nutzen.

Du bezahlst außerdem für metered usage. Einer der am häufigsten unterschätzten Zähler ist Data Transfer—vor allem Outbound Traffic.

Cloud ist oft wie ein Premium-Service bepreist: sie verwandelt Unsicherheit in eine Rechnung, die du heute bezahlen kannst, statt Kapazität kaufen und betreiben zu müssen.

Auf Dedicated zahlst du eine „Responsibility Tax“

Du verantwortest:

- OS- und Dependency-Patching

- Monitoring und Alerting

- Backups und Restore-Tests

- Security Hardening

- Capacity Planning

- Hardware-Lifecycle und Ausfälle

Du kannst Teile outsourcen (Managed Hosting, Smart Hands, Support-Verträge), aber das System bleibt „deins“.

Der Upside: weniger metered Überraschungen und klarere Performance-Grenzen—wenn du es diszipliniert betreibst.

Handlungsspielraum bei Incidents (das, was die meisten Kostenmodelle ignorieren)

Public Cloud kann Hardware-Ausfälle abfedern, schafft aber auch eine Abhängigkeitsgrenze. Bei Upstream-Plattformproblemen, regionalen Incidents, Policy-Änderungen oder Account-Limitierungen ist deine Remediation möglicherweise eingeschränkt. Dedicated Infrastruktur erhöht die Bandbreite an Problemen, die du selbst lösen kannst—macht aber zugleich mehr Probleme „zu deinem Problem“. Es geht nicht darum, welches Modell „generell zuverlässiger“ ist; es geht um Kontrolle, Blast Radius und wer die Hebel in der Hand hält, wenn etwas bricht.

Wo VPS hineinpasst (der Teil, den viele Vergleiche überspringen)

Viele „Dedicated vs. Cloud“-Artikel ignorieren die Option, die in der Praxis sehr häufig gekauft wird: VPS.

Ein VPS ist oft die richtige Antwort, wenn du willst:

- einen Server, den du end-to-end per SSH kontrollierst

- planbare monatliche Kosten

- weniger Betriebsaufwand als eigene Hardware

- schnelleres Provisioning als Kaufen und Racking

Aber ein VPS ist oft Multi-Tenant auf physischem Host-Level, wodurch du einige der gleichen „Shared Resource“-Effekte erben kannst, die Dedicated überhaupt attraktiv machen (Performance-Variabilität, IO-Contention etc.). Manche VPS-Angebote mitigieren das über dedizierte CPU-Zuteilungen oder Performance-Tiers—die Grundlogik bleibt:

- VPS: einfacher und oft günstiger als Dedicated, meist „gut genug“, aber keine Garantie auf konsistente Performance unter allen Bedingungen.

- Dedicated: klarere Isolation und Vorhersagbarkeit, aber mehr Verantwortung und weniger Elastizität.

- Cloud: maximale Optionalität und Managed Building Blocks, aber Metering und Komplexität können schnell eskalieren.

Wenn du konkret zwischen VPS und Dedicated entscheidest:

- nimm VPS, wenn Multi-Tenancy akzeptabel ist und du Speed/Simplicity willst

- nimm Dedicated, wenn die Workload sensibel auf Performance-Varianz, IO, konstanten Durchsatz oder strikte Isolation reagiert

Wann Dedicated Server weiterhin Sinn ergeben (die kurze Liste, die standhält)

Dedicated Server verdienen ihren Platz, wenn eine Workload eine oder mehrere dieser Eigenschaften hat.

1) Deine Workload ist stabil 24/7 (Base Load)

Cloud-Economics glänzen, wenn du runterfahren kannst, dynamisch skalierst oder schnell auf Managed Services umbaust.

Wenn ein Service aber den ganzen Tag, jeden Tag, mit signifikanter Auslastung läuft, kaufst du oft Flexibilität, die du nicht nutzt. Genau hier tauchen Repatriation-Muster auf: stabile Workloads kommen zurück, weil sie prognostizierbar sind und von Fixed-Cost-Kapazität profitieren.

Reality Check: Zieh 30 Tage CPU/RAM-Utilization. Wenn die Kurve praktisch flach ist, solltest du mindestens eine Dedicated-Baseline modellieren.

Wo VPS passt:

- VPS kann auch für Base Load funktionieren—bis Performance-Vorhersagbarkeit kritisch wird oder du immer größere Instanzen kaufst, ohne die gewünschte Stabilität zu bekommen.

2) Du bist data-transfer heavy (Egress ist strukturell teuer)

Wenn dein Produkt „Bytes bewegen“ ist, ist Outbound Transfer kein Rundungsfehler, sondern ein zentraler Cost Driver.

Typische Egress-heavy Patterns:

- Streaming und große Downloads

- Distribution großer Datensätze

- Analytics Exports

- Multi-Region-Replikation und Cross-Zone-Traffic

- „Chatty“ Architekturen mit viel Service-zu-Service-Kommunikation

Dedicated Infrastruktur kann—je nach Vertragsmodell—flachere Bandbreiten-Economics bieten, was bei großem, planbarem Outbound Traffic attraktiv sein kann.

Wo VPS passt:

- VPS ist oft okay bei moderatem Traffic.

- Bei großem, stabilem Bandbreitenprofil: Bandbreitenmodell prüfen (Commit, Included Transfer, Overage, Fair Use). Die Economics variieren stark.

3) Du brauchst vorhersagbare Latenz und Jitter (Consistency schlägt Peak Performance)

Viele Teams jagen „mehr CPU“ hinterher, obwohl das echte Problem Variabilität ist.

In Shared-Umgebungen kann Contention so aussehen:

- gelegentlich langsame Queries

- spiky IO-Latenz

- intermittierende Timeouts

- „manchmal ist es langsam“-Incidents, die schwer reproduzierbar sind

Dedicated reduziert diese Variabilität, weil du Host-Level-Resource-Sharing eliminierst.

Wo VPS passt:

- VPS ist oft ausreichend für Web Apps, APIs und Services, die gelegentliche Varianz tolerieren.

- Wenn „manchmal langsam“ ein Business-Problem ist (oder ein Incident-Treiber), wird Dedicated leichter zu rechtfertigen.

4) Dein Workflow hängt an „Hot Data“-Zugriff (Storage + Locality sind das Produkt)

Nicht alle Performance-Probleme sind CPU-Probleme. Manchmal ist Performance schlicht: Datei sofort öffnen.

Wenn Nutzer wiederholt große Working Sets brauchen (Media Assets, CAD-Files, große Repos, interne Datensätze), zahlst du in:

- Transfer-Zeit

- Latenz

- Reibung und Kontextwechsel

Dedicated Infrastruktur—vor allem nahe bei den Nutzern oder mit schneller privater Connectivity—kann „Warten“ zu „Arbeiten“ machen.

Wo VPS passt:

- VPS funktioniert oft für Remote-Teams und leichtere Datensätze.

- Bei schwerem, wiederholtem Datenzugriff dominieren Locality und Throughput die Entscheidung.

5) Du brauchst klarere Control Boundaries (Governance, Audits, Data Locality)

Operativ geht Governance um:

- wo Daten liegen

- wer Zugriff hat (inkl. physischer Grenzen)

- welche Audit-Evidenz du liefern kannst

- wie gut du Segregation und Chain-of-Custody erklären kannst

Cloud kann compliant sein, aber Dedicated kann leichter zu erklären, zu auditieren und durchzusetzen sein—besonders wenn du deterministische Locality oder klare vertragliche Grenzen brauchst.

Wo VPS passt:

- VPS kann viele Governance-Anforderungen erfüllen, vor allem mit starker Verschlüsselung und guten Access Controls.

- Dedicated wird attraktiver, wenn du strengere Isolationsgarantien oder klarere physisch/logische Grenzen brauchst.

6) Du betreibst always-on interne Labs, Build Farms, Training oder Simulationen

Manche Umgebungen sind „Dauerbetrieb“:

- Testbeds

- CI/Build Farms

- Netzwerk-Labs

- Long-Running-Simulationen

- Staging, das nie schläft

Das sind stabile Workloads, die von „buy once, use constantly“ profitieren. Cloud bleibt nützlich für Spikes (temporäre Bursts), aber eine Dedicated-Baseline ist oft sinnvoll.

Wo VPS passt:

- VPS ist super für kleinere Labs und Build-Systeme.

- Dedicated wird interessant, wenn es groß, konstant und performance-sensitiv wird.

Wann Cloud oder VPS die bessere Antwort ist (so zu tun als ob kostet Geld)

Das ist kein „Cloud ist schlecht“-Text. Cloud gewinnt—klar—in mehreren Situationen.

1) Nachfrage ist unvorhersehbar oder bursty

Wenn du wirklich „manchmal 2 Server, manchmal 200“ brauchst, wird Fixed Capacity entweder:

- teuer durch Overprovisioning oder

- ein Rezept für Downtime und Panik

Clouds stärkster Value bleibt Elastizität.

2) Managed Services ersetzen ganze Kategorien Arbeit

Wenn Managed Databases, Queues, Object Storage und Identity deinen Ops-Aufwand massiv reduzieren, kann Cloud billiger sein auf die einzige Weise, die zählt: Total System Cost, nicht nur Compute-Preis.

3) Dein Team kann nicht zu operativer Reife committen

Dedicated verzeiht nicht:

- „Backups später“

- „Patching wenn wir dran denken“

- „Security Hardening nach dem Launch“

Wenn du Patch Cadence, Monitoring, Restore Drills und Incident Response nicht zuverlässig hinbekommst, ist Dedicated keine Kostenoptimierung—sondern ein Reliability Downgrade.

VPS sitzt dazwischen:

- du managst OS/Security/Backups, aber nicht die physische Hardware

- oft der beste Kompromiss für Teams, die Kontrolle wollen ohne den kompletten Lifecycle zu ownen

Das Decision Framework, das du wirklich nutzen kannst

Hör auf, „Cloud vs. Dedicated“ zu diskutieren. Entscheide Workload für Workload mit einem wiederholbaren Prozess.

Schritt 1: Klassifiziere die Workload

Tagge einen Service:

- Base Load: stabil 24/7 vs Spiky: saisonal/bursty

- Data-heavy: viel Outbound Transfer vs Compute-heavy: CPU-bound

- Latency-sensitive: interaktiv/user-facing vs Latency-tolerant: Batch

- Governance constraints: strikte Locality/Control vs Standard

Schritt 2: Modelliere die drei Kosten-Blöcke

Du vergleichst nicht zwei Rechnungen. Du vergleichst drei Realitäten:

1. Plattformkosten

- Cloud compute + storage + outbound bandwidth/egress

- VPS instance costs + storage + bandwidth model

- Dedicated costs + bandwidth model

2. People/Ops-Kosten

- patching, security, backups, monitoring, on-call, incident response

3. Failure Costs

- downtime impact, performance variability, recovery time

Die meisten „Cloud ist günstiger / Dedicated ist günstiger“-Debatten scheitern, weil sie nur Block #1 zählen.

Schritt 3: Wähle nach dem, was du kaufst

- Wähle Cloud, wenn du Optionalität kaufst: Geschwindigkeit, Burst, Managed Building Blocks.

- Wähle VPS, wenn du Kontrolle und Einfachheit kaufst: ein planbarer Server, den du managst, ohne Hardware zu besitzen.

- Wähle Dedicated, wenn du Certainty kaufst: vorhersagbare Performance-Grenzen und stabilere Long-Run-Economics—sofern du es gut betreiben kannst.

Der realistischste Endzustand: „Cloud smart“ Hybrid

Wenn „Cloud Repatriation“ bei dir wie ein U-Turn zurück nach 2008 klingt: falsches Bild.

Die meisten Organisationen, die neu balancieren, verlassen die Cloud nicht. Sie:

- schaffen eine Dedicated Baseline für stabile, performance-sensitive oder data-heavy Workloads

- nutzen VPS für straightforward Services, wo „Server Control“ zählt und Multi-Tenancy okay ist

- behalten Cloud für Experimente, globale Distribution, Bursting und Managed Services

Das ist „Cloud smart“: nicht eine Antwort—sondern ein Portfolio.

FAQs

Meistens passiert es als selektives Rebalancing, nicht als massiver Rückzug. Einige Workloads kommen zurück wegen Planbarkeit und Kontrolle, während Cloud-Adoption insgesamt weiterwächst.