S3 Object Storage in Europa: wat je moet beoordelen voordat je ook maar één byte opslaat

Object storage was vroeger een bijzaak. Je koos een willekeurige aanbieder met een S3-compatible API, richtte je backupscripts erop en ging verder. De aanname was dat object storage een commodity is — dat de ene bucket min of meer hetzelfde is als de andere.

Die aanname begint mensen geld, data en nachtrust te kosten.

De markt voor object storage in Europa bevindt zich op een vreemd punt. De vraag groeit snel — gedreven door backupstrategieën, compliance-archivering, AI-trainingsdata en het enorme volume aan ongestructureerde data dat organisaties produceren. Maar de kwaliteit van het aanbod is ongelijk. Sommige aanbieders lanceerden object storage in hoog tempo om marktaandeel te pakken, om vervolgens tegen capaciteitsgrenzen aan te lopen, meerdaagse storingen te veroorzaken en met onbereikbare supportkanalen te kampen zodra productiewerklasten binnenkwamen. Anderen bieden solide uptime, maar slaan je data op onder Amerikaanse jurisdictie, waardoor Europese organisaties moeten kiezen tussen betrouwbaarheid en compliance. Als je enige tijd doorbrengt in sysadmin- of infrastructuurcommunities, tref je mensen aan die actief op zoek zijn naar Europese S3-alternatieven en weinig vinden.

Als je op dit moment S3-compatible object storage in Europa evalueert, is dit wat er werkelijk toe doet — en wat de meeste vergelijkingspagina’s je niet vertellen

TL;DR

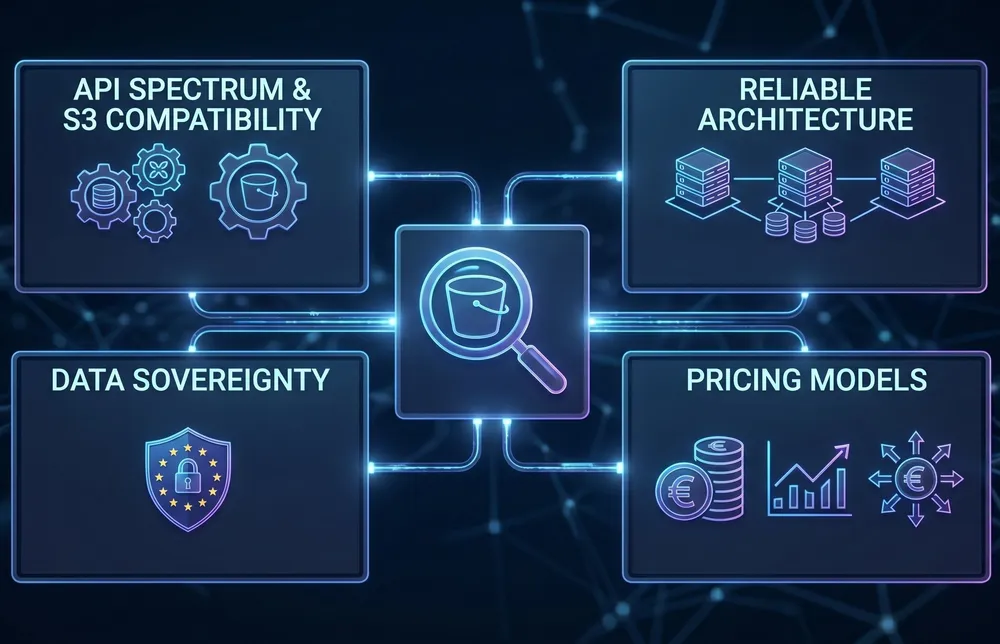

- S3-compatibiliteit is een spectrum. Sommige aanbieders implementeren de basis; slechts weinigen leveren het volledige protocol met consistente betrouwbaarheid op schaal.

- De betrouwbaarheid van object storage hangt af van de architectuur, niet van beloftes. Gedistribueerde ontwerpen over meerdere locaties zijn fundamenteel weerbaarder dan opstellingen op één locatie.

- Datasoevereiniteit is een wettelijke verplichting voor Europese organisaties, geen marketingvinkje. Weet precies waar je objecten terechtkomen en onder wiens jurisdictie.

- Prijsmodellen lopen enorm uiteen. API-verzoekkosten, ophaalkosten en egress-kosten kunnen je effectieve opslagkosten verdubbelen of verdrievoudigen.

S3-compatibiliteit is een spectrum, geen ja of nee

Elke Europese opslagaanbieder claimt S3-compatibiliteit. Vrijwel geen van hen specificeert wat dat daadwerkelijk betekent voor jouw werklasten.

Het S3 API-oppervlak is groot. Basisbewerkingen — PUT, GET, DELETE, buckets opsommen — zijn relatief eenvoudig te implementeren. Maar productiewerklasten zijn afhankelijk van een veel breder scala aan mogelijkheden: multipart uploads, versiebeheer, lifecycle policies, conditionele writes, CORS-configuratie, pre-signed URL’s en fijnmazige toegangscontrole via bucket policies. Het gat tussen “ondersteunt S3” en “implementeert S3 volledig” is waar applicaties vastlopen, migraties stilvallen en backupjobs stilletjes falen.

Sommige aanbieders hanteren write-once semantics — wat betekent dat je een bestaand object niet kunt bijwerken of overschrijven. Dat is een legitieme ontwerpkeuze voor archiveringswerklasten, maar het is fundamenteel onverenigbaar met applicaties die standaard S3-gedrag verwachten. Als je applicatie objecten schrijft, bijwerkt en leest als onderdeel van de normale workflow, zal een WORM-only implementatie deze op manieren breken die niet meteen zichtbaar zijn tijdens initiële tests.

Test voor je data toevertrouwt je daadwerkelijke workflow tegen de doelopslagomgeving. Niet een synthetische benchmark — je echte backuptool, je echte applicatie, je echte datapatronen. Draai het een week, niet een middag.

Betrouwbaarheid is architectuur, geen marketingbelofte

De beschikbaarheid van object storage is een van die dingen waar niemand over nadenkt tot het misgaat. En als het misgaat, heeft dat de neiging om te cascaderen — backups kunnen niet worden afgerond, applicatie-assets worden onbereikbaar, compliance-archieven worden ontoegankelijk precies wanneer een auditor ze nodig heeft. Sommige teams hebben gemeld dat hun opslag dagenlang onbereikbaar was, niet urenlang. Op dat punt heb je geen infrastructuur. Je hebt een aansprakelijkheid.

De betrouwbaarheid van elke opslagdienst is een directe functie van de architectuur. Twee vragen zijn belangrijker dan welk SLA-getal dan ook op een website:

- Hoe wordt data gedistribueerd? Een object store op één locatie is een single point of failure, ongeacht hoeveel schijven erin draaien. Als al je objecten in één faciliteit staan, haalt een stroomstoring, een netwerkpartitie of een capaciteitsbeperking in die faciliteit alles tegelijk offline. Sommige aanbieders bieden helemaal geen replicatie — zelfs niet binnen dezelfde regio. Je data bestaat op één plek, in één kopie, en als die faciliteit een probleem heeft, gaat de dienst gewoon plat zonder failover. Multi-locatie-architecturen, waarbij data versleuteld, gefragmenteerd en verdeeld wordt over meerdere onafhankelijke locaties, bieden fundamenteel andere faalkarakteristieken. Het onderscheid is belangrijk: een dienst die data spiegelt over drie onafhankelijke faciliteiten kan een heel datacenter verliezen zonder ook maar één byte kwijt te raken.

- Wat gebeurt er onder belasting? Sommige opslagplatforms presteren goed bij gemiddelde bezetting maar verslechteren sterk wanneer de capaciteit volloopt of het aantal verzoeken piekt. Time-outs, mislukte writes en verminderde prestaties tijdens piekgebruik zijn symptomen van een architectuur die is gedimensioneerd voor een kleinere werklast dan deze nu draagt. Dit is bijzonder verraderlijk wanneer de degradatie locatieafhankelijk is — één datacenterregio presteert prima terwijl een andere consistent overbelast is omdat de vraag de capaciteit is ontgroeid. Vraag je aanbieder wat er gebeurt bij 80% bezetting. Als ze niet met details kunnen antwoorden, is dat het antwoord.

Rate limits zijn een ander aandachtspunt. Een plafond van een paar honderd verzoeken per seconde per bucket kan prima zijn voor archiveringswerklasten, maar is volstrekt ontoereikend voor het serveren van applicatie-assets, contentlevering of hoogfrequente backupoperaties.

Begrijp de limieten voordat je in productie bent, niet nadat je monitoringmeldingen beginnen af te gaan.

Er speelt hier een bredere rijpheidsvraag. S3 als protocol bestaat al bijna twee decennia. Het is een goed begrepen, goed gedocumenteerde interface. De tooling is volwassen. De clientbibliotheken zijn beproefd in de praktijk. Het bouwen van een betrouwbare S3-compatible dienst is geen onderzoeksprobleem — het is een engineering- en operationele uitdaging die goede capaciteitsplanning, redundantieontwerp en operationele discipline vereist. Als een aanbieder zijn object storage meer dan een jaar geleden heeft gelanceerd en het nog steeds het soort betrouwbaarheidsproblemen vertoont dat je van een bètaproduct zou verwachten, zegt dat iets over de onderliggende architectuur, niet over hoe moeilijk S3 te implementeren is.

Datasoevereiniteit is een wettelijke verplichting, geen feature

Voor Europese organisaties is de vraag waar je data fysiek opgeslagen wordt verschoven van een nice-to-have naar een wettelijke verplichting. De GDPR is van kracht sinds 2018, maar de handhaving wordt strenger. De nationale implementaties van NIS2 worden in 2026 uitgerold over de EU-lidstaten, waarbij artikel 21 expliciet eist dat organisaties risicobeoordelingen van de toeleveringsketen uitvoeren — inclusief de infrastructuuraanbieders waarvan je afhankelijk bent.

De praktische implicatie: het is niet voldoende om te weten dat je opslagaanbieder een datacenter in Europa heeft.

Je moet weten in welk specifiek land je data zich bevindt, of de aanbieder onderworpen is aan niet-EU-wetgeving voor datatoegang (zoals de Amerikaanse CLOUD Act), en of je lokalisatie kunt aantonen bij een audit.

Gartner raamt de uitgaven voor soevereine cloudinfrastructuur op ongeveer 80 miljard USD in 2026, waarbij Europese soevereine cloud met circa 83% jaar-op-jaar groeit. Dit is geen nichezorg. Het is de richting waarin de markt beweegt, gedreven door regelgeving, corporate governance en de praktische realiteit dat het aantonen van dataresidencie een inkoopvereiste wordt voor enterprise-contracten.

Bij het evalueren van object storage betekent soeverein meer dan een vlaggetje op een datacenter. Het betekent: Europees bedrijf, Europese infrastructuur, Europese jurisdictie, en geen juridisch mechanisme waarmee een buitenlandse overheid toegang tot je data kan afdwingen. Als je aanbieder niet alle vier kan aantonen, heeft je compliancepositie een gat.

Dit creëert een praktisch dilemma. De meest aanbevolen S3-compatible alternatieven — Cloudflare R2, Backblaze B2, Wasabi — zijn allemaal in de VS gevestigde bedrijven. Ze exploiteren mogelijk Europese datacenters, maar het moederbedrijf blijft onderworpen aan Amerikaanse wetgeving, inclusief de CLOUD Act. Voor Europese organisaties die zowel betrouwbare S3-opslag als echte datasoevereiniteit nodig hebben, is de lijst van aanbieders die aan beide criteria voldoen historisch gezien erg kort geweest. Dat begint te veranderen, maar het betekent dat je de bedrijfsstructuur van je opslagaanbieder moet evalueren, niet alleen het datacenteradres.

Het prijsmodel is belangrijker dan de prijs

Object storage-prijzen hebben een transparantieprobleem. Het kopcijfer — een paar euro per terabyte per maand — lijkt overzichtelijk totdat je bekijkt waarvoor je nog meer betaalt.

Uit een recent onderzoek onder ruim 400 IT-leiders bleek dat 95% te maken kreeg met onverwachte kosten op hun cloudopslagfacturen. Bijna de helft van de totale opslagkosten ging naar kosten bovenop de basisopslagcapaciteit — API-verzoekkosten, data-ophaalkosten, replicatietoeslagen, kosten voor opslagklasse-overgangen en egress-bandbreedte. Bij een grote hyperscaler voegden die extra kosten ongeveer 41% toe bovenop de opslagcapaciteitsprijs.

Het patroon is consistent: aanbieders bieden een concurrerende opslagprijs en verdienen vervolgens aan elke interactie met je data. Uploaden kost geld. Downloaden kost geld. Je objecten opsommen kost geld. Data verplaatsen tussen opslaglagen kost geld. En vertrekken — je data naar een andere aanbieder verplaatsen — kost het meest.

Egress-kosten fungeren als een lock-in-mechanisme, waardoor de overstapkosten onevenredig hoog worden zodra je data een bepaalde schaal bereikt.

Vergelijk bij het evalueren van prijzen niet alleen de prijs per terabyte. Modelleer je daadwerkelijke gebruikspatroon: hoeveel data je opslaat, hoe vaak je schrijft en leest, hoeveel bandbreedte je applicaties verbruiken, en wat het zou kosten om je data eruit te halen als je zou willen overstappen. Het goedkoopste opslagtarief is betekenisloos als de operationele kosten de rekening verdubbelen.

De open-source opslaglaag verschuift

Als je je eigen object storage draait met open-source software, is het landschap het afgelopen jaar aanzienlijk veranderd.

MinIO, de meest gebruikte open-source S3-compatible object store, stapte in 2021 over van Apache 2.0 naar AGPLv3-licentie. Sindsdien heeft de community-editie geleidelijk features verloren — de webgebaseerde admin-UI werd in 2025 verwijderd en de community-repository ging in onderhoudsmodus voordat deze begin 2026 werd gearchiveerd. Er werd geen migratiegids verstrekt. Voor teams die hun opslaginfrastructuur hadden gebouwd rondom MinIO’s community-editie creëerde dit een urgente noodzaak om alternatieven te evalueren.

Alternatieven bestaan — RustFS, Garage, SeaweedFS, Ceph RGW — maar de meeste missen de commerciële ondersteuning, ecosysteemrijpheid en het bewezen productiegebruik dat MinIO in de loop der jaren had opgebouwd. Voor organisaties die hun opslaglaag niet willen laten afhangen van een klein open-source project, of die de engineeringinvestering van het zelf draaien en onderhouden van een opslagcluster niet kunnen rechtvaardigen, is beheerde S3-compatible opslag van een betrouwbare aanbieder een aantrekkelijker optie geworden dan twee jaar geleden.

Dit is geen pleidooi tegen zelfgehoste opslag. Als je het team, de expertise en de operationele bereidheid hebt, geeft het draaien van je eigen object store je maximale controle. Maar als je eerlijk bent over de kosten van het gezond, gepatcht en performant houden van een opslagcluster 24/7, is de vergelijking met een beheerde dienst het waard om goed te maken.

Wat je moet evalueren voordat je je vastlegt

Of je nu voor het eerst object storage kiest of je huidige aanbieder heroverweegt, hier is een praktische evaluatiechecklist:

- Protocolcompleetheid. Ondersteunt de aanbieder het volledige S3 API-oppervlak dat je werklasten vereisen? Versiebeheer, lifecycle policies, multipart uploads, conditionele writes, bucket policies? Vraag om een compatibiliteitsmatrix voordat je gaat testen.

- Architectuur en redundantie. Waar wordt data fysiek opgeslagen? Hoeveel onafhankelijke locaties? Wat is het replicatiemodel? Opslag op één locatie met RAID is niet hetzelfde als geo-gedistribueerde opslag over meerdere faciliteiten.

- Prestaties onder belasting. Wat zijn de gedocumenteerde rate limits per bucket? Wat gebeurt er bij hoge bezetting? Vraag om specifieke informatie over degradatiegedrag en capaciteitsplanning. Vage antwoorden over onbeperkte schaling zijn een rode vlag.

- Datasoevereiniteit. Is de aanbieder een Europees bedrijf dat Europese infrastructuur exploiteert? Wordt de data uitsluitend binnen EU-grenzen opgeslagen? Is er een juridisch pad voor niet-EU-overheidstoegang? Kun je residencie aantonen bij een audit?

- Kostentransparantie. Hoe zien de totale kosten eruit voor je daadwerkelijke gebruikspatroon, inclusief API-verzoeken, ophaalkosten, bandbreedte en mogelijke egress? Zijn de prijzen voorspelbaar van maand tot maand, of variabel op basis van gebruik dat je niet volledig kunt beheersen?

- Versleuteling en beveiligingsmodel. Is data versleuteld at rest en in transit? Wie beheert de encryptiesleutels? Kan een enkel gecompromitteerd knooppunt volledige objecten blootleggen, of is data gefragmenteerd op een manier die reconstructie vanaf één locatie voorkomt?

- Support en operationele volwassenheid. Hoe ziet support eruit om 3 uur ’s nachts op een zaterdag wanneer je opslag plat ligt en je applicatie kapot is? Kun je daadwerkelijk een mens bereiken, of werkt het supportformulier zelf ook niet? Dit is geen hypothetisch scenario — er zijn aanbieders wier contactmechanismen net zo onbetrouwbaar zijn als de diensten die ze horen te ondersteunen. Let op gepubliceerde gemiddelde responstijden, 24/7-beschikbaarheid en een trackrecord van het oplossen van problemen, niet alleen het erkennen ervan.

- Vertrekkosten. Hoeveel zou het kosten om je data naar een andere aanbieder te verplaatsen? Egress-prijzen zijn het duidelijkste signaal of een aanbieder vertrouwt op het behouden van klanten door servicekwaliteit of door financiële lock-in.

Waar Worldstream past

Worldstream heeft onlangs S3-compatible object storage gelanceerd, gebouwd op de DS3 Composer-technologie van Cubbit. De architectuur is ontworpen rond de hierboven beschreven principes: data wordt versleuteld, gefragmenteerd en gedistribueerd over drie onafhankelijke Worldstream-datacenters in Nederland. Geen enkel datafragment bestaat in leesbare vorm op één locatie, wat weerbaarheid biedt tegen zowel incidenten op faciliteitsniveau als cyberaanvallen.

De technologiestack is 100% Europees. Worldstream is een Nederlands bedrijf dat zijn eigen datacenters en netwerkinfrastructuur exploiteert. Cubbit is een Italiaans bedrijf dat de gedistribueerde opslagsoftwarelaag levert. Er zit geen Amerikaans hoofdkwartier in de keten, wat betekent dat er geen CLOUD Act-blootstelling is. Voor organisaties die GDPR- en NIS2-toeleveringsketenvereisten navigeren, is dat een eenvoudige compliancepositie.

De dienst ondersteunt standaard S3- en Swift-protocollen. 24/7-support met een gepubliceerde gemiddelde responstijd van 7 minuten. De architectuur is ontworpen voor nul technologische lock-in — je data is toegankelijk via standaard S3-tooling, en je bent nooit afhankelijk van proprietary clientsoftware of API’s.

Dat is het feitelijke beeld. Of het bij jouw werklast past, hangt af van je specifieke eisen op het gebied van protocolondersteuning, prestaties en prijzen. Wij zien liever dat je grondig evalueert en de juiste keuze maakt dan dat je een beslissing neemt op basis van een verkooppagina.

De echte vraag is niet waar je opslaat. Het is wat er gebeurt als het misgaat.

Object storage is saaie infrastructuur. Het hoort saai te zijn — je schrijft data, je leest data, het is er wanneer je het nodig hebt. De interessante vraag is wat er gebeurt wanneer die aanname breekt. Wanneer een faciliteit offline gaat. Wanneer de bezetting de capaciteit bereikt. Wanneer een overheid toegang vraagt. Wanneer je weg wilt. Wanneer je hulp nodig hebt en er daadwerkelijk iemand opneemt.

De aanbieders die die vragen beantwoorden met architectuur, niet met marketing, zijn degenen waarbij het de moeite waard is om een petabyte op te slaan.

FAQ

S3-compatibiliteit betekent dat een opslagdienst het S3 API-protocol van Amazon implementeert, waardoor je bestaande S3-tools, -bibliotheken en -applicaties zonder aanpassing kunt gebruiken. De mate van compatibiliteit verschilt echter aanzienlijk tussen aanbieders. Sommigen implementeren alleen basisbewerkingen (PUT, GET, DELETE), terwijl anderen het volledige API-oppervlak ondersteunen, inclusief versiebeheer, lifecycle policies, multipart uploads en fijnmazige toegangscontrole. Verifieer altijd de compatibiliteit met je specifieke werklasten in plaats van alleen op het label af te gaan.